بينما يفتح الذكاء الاصطناعي آفاقًا جديدة لا حصر لها من الفرص، فإنه يُدخل أيضًا مجموعة كاملة من التهديدات المستجدة. ويسمح الذكاء الاصطناعي التوليدي للمجرمين بإنشاء مقاطع تزييف عميق ومواقع ويب مزيفة، وإرسال رسائل البريد العشوائي، بل وحتى انتحال صفة أفراد عائلتك وأصدقائك. ويستعرض هذا المقال كيفية استخدام الشبكات العصبية لتنفيذ عمليات الاحتيال والتصيد الاحتيالي، وبالطبع، سنشارككم نصائح عن كيفية البقاء في أمان. ولإلقاء نظرة أكثر تفصيلاً على مخططات التصيد الاحتيالي التي تعمل بالذكاء الاصطناعي، يمكنك مراجعة التقرير الكامل على Securelist.

احتيال الاستثمار الرومانسي وانتحال الشخصية الإلكتروني والتزييف العميق

يستخدم المحتالون روبوتات الذكاء الاصطناعي التي تنتحل صفة أشخاص حقيقيين، خاصة في عمليات الاحتيال الرومانسية. وتنشئ هذه الروبوتات شخصيات وهمية ومصطنعة، وتتواصل مع ضحايا متعددين في وقت واحد لبناء روابط عاطفية قوية. وقد يستمر هذا الخداع لأسابيع أو حتى أشهر، حيث يبدأ بمغازلة خفيفة ثم يتحول تدريجيًا إلى مناقشات عن “فرص استثمار مربحة”. ويساعد هذا الارتباط الشخصي طويل الأمد على تبديد أي شكوك لدى الضحية، لكن عملية الاحتيال تنتهي بالطبع بمجرد أن يستثمر الضحية أمواله في مشروع مزيف. وتُعرف هذه الأنواع من المخططات الاحتيالية باسم “احتيال ذبح الخنزير” (Pig Butchering)، والذي تناولناه بالتفصيل في منشور سابق. وبينما كانت هذه العمليات تدار في السابق بواسطة مزارع احتيال ضخمة في جنوب شرق آسيا توظف آلاف الأشخاص، فإنها تعتمد الآن بشكل متزايد على الذكاء الاصطناعي.

جعلت الشبكات العصبية انتحال الشخصية الإلكتروني – حيث ينشئ المحتالون هوية مزيفة أو ينتحلون شخصية حقيقية – أسهل بكثير. وتستطيع الشبكات العصبية التوليدية الحديثة تقليد مظهر الشخص أو صوته أو أسلوب كتابته بدرجة كافية من الدقة. وكل ما يحتاج إليه المحتال هو جمع معلومات متاحة للعامة عن شخص ما وتغذية هذه البيانات إلى الذكاء الاصطناعي. ويمكن أن يكون أي شيء مفيدًا في هذه العملية: الصور ومقاطع الفيديو والمنشورات والتعليقات العامة، والمعلومات عن الأقارب والهوايات والعمر، وما إلى ذلك.

لذلك، إذا أرسل إليك أحد أفراد العائلة أو صديق رسالة من حساب جديد، وطلب منك، على سبيل المثال، أن تقرضه مالاً، فمن المحتمل جداً أنه ليس قريبك أو صديقك الحقيقي. وفي مثل هذا الموقف، فإن أفضل إجراء هو التواصل مع الشخص الحقيقي عبر وسيلة أخرى، مثل الاتصال به هاتفيًا، وسؤاله مباشرة عما إذا كان كل شيء على ما يرام. ويُعدّ طرح بعض الأسئلة الشخصية التي لا يمكن للمحتال العثور عليها عبر الإنترنت أو حتى في رسائلك السابقة، تصرفًا ذكيًا آخر لتوخي الحذر.

لكن انتحال الشخصية النصي المُقنع ليس سوى جزء من المشكلة، حيث يمثل كل من التزييف العميق للصوت والفيديو تهديداً أكبر. وقد شاركنا مؤخرًا كيف يستخدم المحتالون التزييف العميق لمدونين ومستثمري عملات مشفرة مشهورين على وسائل التواصل الاجتماعي. ويدعو هؤلاء المشاهير المزيفون المتابعين إلى “استشارات شخصية” أو “محادثات استثمار حصرية”، أو يعدونهم بجوائز نقدية وهدايا قيّمة.

لكن وسائل التواصل الاجتماعي ليست المكان الوحيد الذي يُستخدم فيه التزييف العميق. ويتم توليدها أيضًا لمكالمات الفيديو والمكالمات الصوتية التي تتم في الوقت الحقيقي. وفي وقت سابق من هذا العام، خسرت امرأة من فلوريدا 15000 دولار أمريكي بعد أن اعتقدت أنها كانت تتحدث مع ابنتها، التي يُفترض أنها تعرضت لحادث سيارة. واستخدم المحتالون تزييفًا عميقًا واقعيًا لصوت ابنتها، بل وقلدوا بكاءها.

وجد خبراء من فريق البحث والتحليل العالمي في شركة Kaspersky عروضًا على الويب المظلم لإنشاء تزييف عميق للفيديو والصوت في الوقت الحقيقي. ويعتمد سعر هذه الخدمات على مدى تعقيد وطول المحتوى المطلوب، حيث يبدأ من 30 دولارًا أمريكيًا فقط للتزييف الصوتي و50 دولارًا أمريكيًا لمقاطع الفيديو. ومنذ عامين فقط، كانت تكلفة هذه الخدمات أعلى بكثير – حيث وصلت إلى 20000 دولار أمريكي للدقيقة الواحدة – ولم يكن التوليد في الوقت الحقيقي متاحًا كخيار.

تُقدّم هذه الإعلانات خيارات مختلفة: تبديل الوجوه في الوقت الحقيقي أثناء مؤتمرات الفيديو أو تطبيقات المراسلة، أو تبديل الوجوه لأغراض التحقق من الهوية، أو استبدال صورة من هاتف أو كاميرا افتراضية.

يعرض المحتالون أيضًا أدوات لمزامنة حركة الشفاه مع أي نص في مقطع فيديو – حتى باللغات الأجنبية، بالإضافة إلى أدوات استنساخ الصوت التي يمكنها تغيير النبرة ودرجة الصوت لمطابقة المشاعر المطلوبة.

على الرغم من ذلك، يشتبه خبراؤنا في أن العديد من هذه الإعلانات المعروضة على الويب المظلم قد تكون عمليات احتيال بحد ذاتها، وهي مُصممة لخداع المحتالين المحتملين الآخرين لجعلهم يدفعون مقابل خدمات غير موجودة في الواقع.

كيفية الحفاظ على أمانك

- لا تثق بمعارفك عبر الإنترنت الذين لم تقابلهم شخصيًا مطلقًا. وحتى لو كنت تتحدث معهم لفترة طويلة وشعرت أنك وجدت “روحًا متجانسة معك”، كن حذرًا إذا أثاروا موضوع العملات المشفرة أو الاستثمارات، أو أي مخطط آخر يتطلب منك إرسال المال إليهم.

- لا تنجرف وراء العروض المغرية وغير المتوقعة التي تبدو وكأنها صادرة عن مشاهير أو شركات كبرى على وسائل التواصل الاجتماعي. وانتقل دائمًا إلى حساباتهم الرسمية للتحقق جيدًا من المعلومات. وتوقّف فوراً إذا طُلب منك في أي مرحلة من مراحل الهدية دفع رسوم أو ضريبة أو تكلفة شحن، أو إدخال تفاصيل بطاقتك الائتمانية لتلقي جائزة نقدية.

- إذا راسلك الأصدقاء أو الأقارب بطلبات غير اعتيادية، فتواصل معهم عبر قناة مختلفة مثل الهاتف. ولضمان أمانك، اسألهم عن شيء تحدثتم عنه خلال آخر محادثة حقيقية جرت بينكم. وبالنسبة للأصدقاء المقربين والعائلة، من الجيد الاتفاق مسبقًا على كلمة سر لا يعرفها سواكم. وإذا كنتم تشاركون مواقعكم مع بعضكم البعض، فتحقق من الموقع وتأكد من مكان وجود الشخص. ولا تقع ضحية لأسلوب التلاعب المعتمد على “الاستعجال” – فقد يخبرك المحتال أو الذكاء الاصطناعي أن الموقف مُلح وليس لديه الوقت للإجابة على أسئلة “سخيفة”.

- إذا ساورتك شكوك أثناء مكالمة فيديو، اطلب من الشخص أن يُحرك رأسه باتجاه جانبي أو أن يؤدي حركة معقدة بيديه. ولا تستطيع تقنية التزييف العميق عادةً تنفيذ هذه الطلبات دون أن تنكشف الخدعة. كذلك، إذا كان الشخص لا يرمش، أو بدت حركات الشفاه أو تعابير الوجه لديه غريبة، فتلك مؤشرات خطر أخرى.

- لا تقم مطلقًا بإملاء أو مشاركة أرقام بطاقات بنكية أو رموز لمرة واحدة أو أي معلومات سرية أخرى.

مثال يوضح انكشاف التزييف العميق عند تدوير الرأس. المصدر

المكالمات الآلية

تُعدّ هذه المكالمات طريقة فعالة لخداع الأفراد دون الحاجة إلى التحدث معهم مباشرة. ويستخدم المحتالون الذكاء الاصطناعي لإجراء مكالمات آلية مزيفة تبدو وكأنها صادرة من البنوك وشركات الاتصالات اللاسلكية والخدمات الحكومية. وعلى الطرف الآخر من الخط لا يوجد سوى روبوت يتظاهر بأنه موظف دعم. ويبدو الأمر حقيقيًا لأن العديد من الشركات الشرعية تستخدم المساعدين الصوتيين الآليين. ومع ذلك، لن تتصل بك شركة حقيقية أبدًا لتخبرك بأن حسابك قد تعرض للاختراق أو لتطلب منك رمز تحقق.

إذا تلقيت مكالمة كهذه، فإن الأمر الأساسي هو التحلي بالهدوء. لا تقع ضحية لأساليب التخويف مثل “حساب مخترق” أو “أموال مسروقة”. وأغلق الخط على الفور، واستخدم الرقم الرسمي على موقع ويب الشركة للاتصال بالشركة الحقيقية. وضع في اعتبارك أن عمليات الاحتيال الحديثة قد تتضمن العديد من الأشخاص الذين يحيلونك إلى بعضهم البعض. وقد يتصلون بك أو يرسلون رسائل نصية من أرقام مختلفة ويتظاهرون بأنهم موظفين في بنك أو مسؤولين حكوميين أو حتى من الشرطة.

روبوتات المحادثة ووكلاء الذكاء الاصطناعي المعرضون للتصيد الاحتيالي

يفضل العديد من الأشخاص الآن استخدام روبوتات الدردشة مثل ChatGPT أو Gemini بدلاً من محركات البحث المألوفة. وقد تتساءل ماذا يمكن أن تكون المخاطر؟ حسنًا، يتم تدريب نماذج اللغة الكبيرة على بيانات المستخدمين، ومن المعروف أن روبوتات الدردشة الشائعة تقترح مواقع تصيد احتيالي على المستخدمين. وعند إجراء عمليات بحث على الويب، يتصل وكلاء الذكاء الاصطناعي بمحركات بحث يمكن أن تحتوي أيضًا على روابط تصيد احتيالي.

في تجربة حديثة، تمكن الباحثون من خداع وكيل الذكاء الاصطناعي في مستعرض Comet التابع لشركة Perplexity باستخدام رسالة بريد إلكتروني مزيفة. وكانت الرسالة البريدية يُفترض أنها مُرسلة من مدير استثمار في Wells Fargo، أحد أكبر البنوك في العالم. أرسل الباحثون الرسالة من حساب تم إنشاؤه حديثًا على خدمة Proton Mail. وقد تضمنت رابطاً لصفحة تصيد احتيالي حقيقية كانت نشطة لعدة أيام لكن لم يتم تصنيفها بعد كضارة من قبل خدمة Google Safe Browsing (التصفح الآمن من Google). وأثناء التنقل عبر صندوق الوارد الخاص بالمستخدم، قام وكيل الذكاء الاصطناعي بتمييز الرسالة على أنها “مهمة يجب تنفيذها من البنك”. ودون أي عمليات تدقيق إضافية، تتبع الوكيل رابط التصيّد الاحتيالي، وفتح صفحة تسجيل الدخول المزيفة، ثم طالب المستخدم بإدخال بيانات اعتماده؛ بل وساعد حتى في ملء النموذج. لقد ضمن الذكاء الاصطناعي في جوهره صفحة التصيّد الاحتيالي. لم يرَ المستخدم أبدًا عنوان البريد الإلكتروني للمرسل المشبوه أو رابط التصيّد الاحتيالي نفسه. وبدلاً من ذلك، تم توجيهه فورًا إلى صفحة إدخال كلمة المرور التي قدمها المساعد الذكي “المفيذ”.

في التجربة ذاتها، استخدم الباحثون منصة Loveable لتطوير الويب المدعومة بالذكاء الاصطناعي لإنشاء موقع ويب مزيف يحاكي متجر Walmart. بعد ذلك، زاروا الموقع في مستعرض Comet – وهو أمر يمكن أن يفعله المستخدم غير المرتاب بسهولة إذا تم خداعه بواسطة رابط تصيّد احتيالي أو إعلان. وطلبوا من وكيل الذكاء الاصطناعي شراء ساعة Apple Watch. وحلل الوكيل الموقع المزيف، ووجد “صفقة رابحة”، وأضاف الساعة إلى سلة المشتريات، وأدخل عنوان الشحن وتفاصيل البطاقة المصرفية المُخزَّنة في المستعرض، وأتمّ “عملية الشراء” دون طلب أي تأكيد. ولو كان هذا الموقع موقعًا احتياليًا حقيقيًا، لكان المستخدم قد خسر مبلغًا كبيرًا من المال، بينما قدّم تفاصيله البنكية على طبق من ذهب للمحتالين.

للأسف، يتصرف وكلاء الذكاء الاصطناعي حاليًا مثل الوافدين السُذّج على الويب، ويقعون بسهولة ضحية للهندسة الاجتماعية. وسبق أن تحدثنا بالتفصيل عن مخاطر دمج الذكاء الاصطناعي في المستعرضات وكيفية تقليلها. لكن للتذكير، لتجنب أن تكون الضحية التالية لمساعد يفرط في الثقة، يجب عليك تقييم المعلومات التي يقدمها بشكل نقدي، وتقييد الأذونات التي تمنحها لوكلاء الذكاء الاصطناعي، وتثبيت حل أمان موثوق يحجب الوصول إلى المواقع الضارة.

مواقع التصيّد الاحتيالي المُوَلَّدة بواسطة الذكاء الاصطناعي

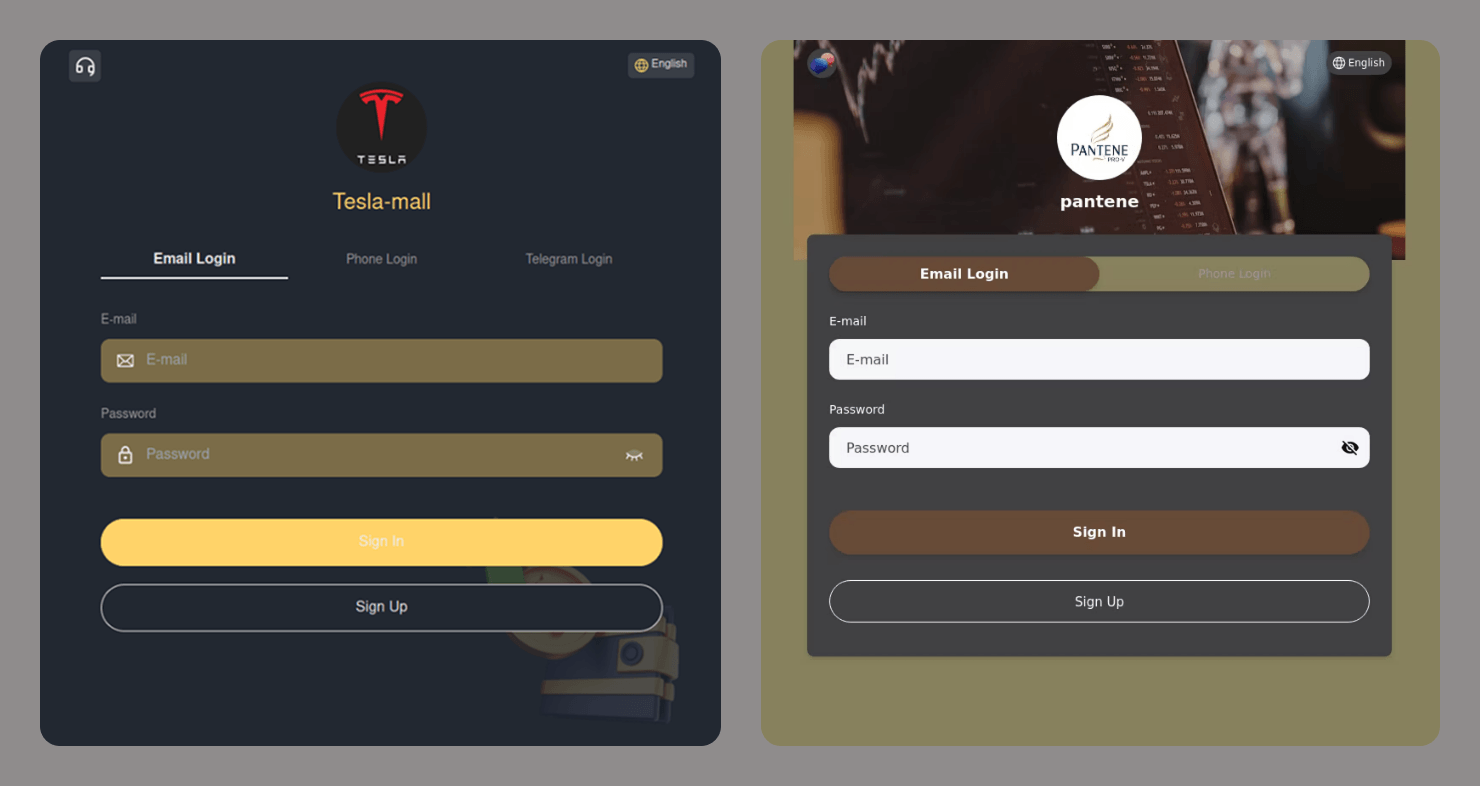

ولت أيام مواقع التصيد الاحتيالي التافهة سيئة التصميم والمحملة بالإعلانات المزعجة. ويبذل المحتالون المعاصرون قصارى جهدهم لإنشاء نسخ مزيفة واقعية تستخدم بروتوكول HTTPS، وتظهر اتفاقيات المستخدم وتحذيرات الموافقة على ملفات تعريف الارتباط، وتتمتع بتصميمات جيدة بشكل معقول. وقد جعلت الأدوات المدعومة بالذكاء الاصطناعي إنشاء مواقع الويب هذه أرخص بكثير وأسرع، إن لم يكن شبه فوري. وقد تجد رابطًا لأحد هذه المواقع في أي مكان: في رسالة نصية أو رسالة بريد إلكتروني أو على وسائل التواصل الاجتماعي أو حتى في نتائج البحث.

كيفية التعرف على موقع تصيد احتيالي

- تحقق من عدم وجود أخطاء إملائية في رابط عنوان الموقع والعنوان والمحتوى.

- تحقق من عمر تسجيل نطاق موقع الويب. ويمكنك التحقق من هذا هنا.

- انتبه إلى اللغة المستخدمة. هل الموقع يحاول إخافتك أو اتهامك؟ هل يحاول استدراجك أو دفعك للتصرف بسرعة؟ أي تلاعب عاطفي هو علامة خطر حمراء كبيرة.

- قم بتمكين ميزة فحص الروابط في أي من حلول الأمان الخاصة بنا.

- إذا حذرك المستعرض من اتصال غير آمن، فغادر الموقع على الفور. وتستخدم المواقع الشرعية بروتوكول HTTPS.

- ابحث عن اسم موقع الويب على الإنترنت وقارن بين عنوان رابط الموقع الموجود لديك وبين الرابط الموجود في نتائج البحث. وكن حذرًا، فقد تعرض محركات البحث روابط تصيد احتيالي مدفوعة في الجزء العلوي من الصفحة. وتأكد من عدم وجود علامة “إعلان” أو “مدفوع” بجوار الرابط.

اقرأ المزيد عن استخدام الذكاء الاصطناعي بأمان:

- كيف تحولت شبكات التواصل الاجتماعي الخاصة بشركة ميتا إلى منصة للاحتيال الاستثماري

- أنت على وشك الحصول على تعويضات كبيرة مرة أخرى

- فيروسات حصان طروادة تتنكر في هيئة عملاء DeepSeek وGrok

- كيف يتجاوز المحتالون عملية التحقق من هوية العميل باستخدام التزييف العميق

- لا تصدق أذنيك: التزييف العميق للصوت

التصيد الاحتيالي

التصيد الاحتيالي

النصائح

النصائح