كيفي تحمي المؤسسات من مخاطر وكلاء الذكاء الاصطناعي الذين تستخدمهم؟ لم يعد هذا التساؤل مجرد افتراض نظري، فبالنظر إلى الأضرار الفعلية التي يمكن أن يسببها الذكاء الاصطناعي المستقل، نجدها تمتد من تقديم خدمة عملاء سيئة وصولاً إلى تدمير قواعد البيانات الأساسية للشركات. إنه سؤال يشغل بال قادة الأعمال حاليًا، بينما تتسابق الوكالات الحكومية وخبراء الأمان لتقديم إجابات عنه.

بالنسبة لمديري تكنولوجيا المعلومات (CIOs) ومديري أمان المعلومات (CISOs)، يمثل وكلاء الذكاء الاصطناعي معضلة كبرى في الحوكمة. يتخذ هؤلاء الوكلاء القرارات، ويستخدمون الأدوات، ويعالجون البيانات الحساسة دون تدخل بشري مباشر. ونتيجة لذلك، تبين أن العديد من أدواتنا التقليدية في تكنولوجيا المعلومات والأمان غير قادرة على كبح جماح الذكاء الاصطناعي أو السيطرة عليه.

أصدرت مؤسسة OWASP غير الربحية دليلاً إرشاديًا عمليًا عن هذا الموضوع تحديدًا. وتغطي قائمتهم الشاملة لأهم 10 مخاطر تواجه تطبيقات الذكاء الاصطناعي الوكيل كل شيء؛ بدءًا من التهديدات الأمنية التقليدية مثل تصعيد الامتيازات، وصولاً إلى معضلات الذكاء الاصطناعي الخاصة مثل تسميم ذاكرة الوكيل. ويأتي كل خطر مصحوبًا بأمثلة من الواقع، وتحليل لكيفية اختلافه عن التهديدات المشابهة، بالإضافة إلى إستراتيجيات الحد من المخاطر. وفي هذا المقال، ختصرنا الأوصاف ودمجنا توصيات الدفاع.

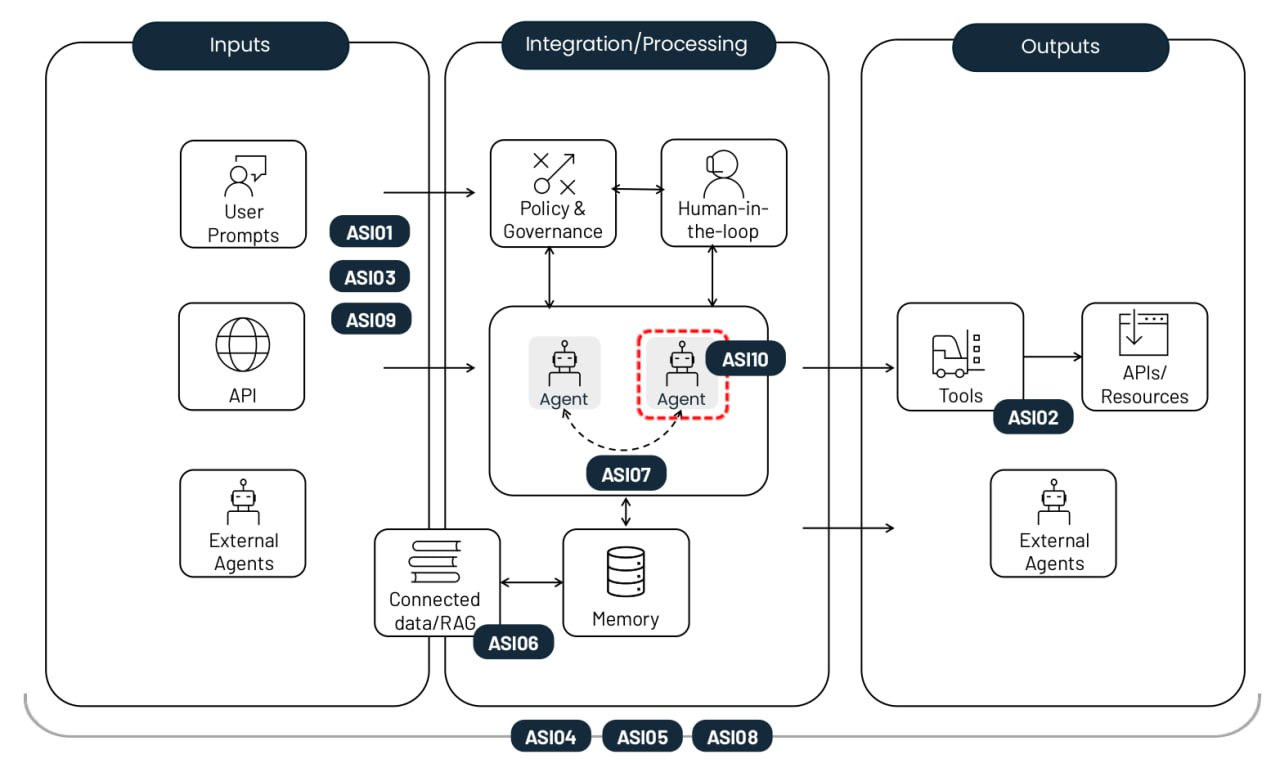

أبرز عشرة مخاطر لنشر وكلاء الذكاء الاصطناعي المستقلين. المصدر

اختطاف هدف الوكيل (ASI01)

ينطوي هذا الخطر على التلاعب بمهام الوكيل أو منطق اتخاذ القرار لديه، وذلك عبر استغلال عجز النموذج الأساسي عن التمييز بين التعليمات المشروعة والبيانات الخارجية. ويستخدم المهاجمون تقنيات حقن المطالبات أو البيانات المزورة لإعادة برمجة الوكيل ودفعه لتنفيذ إجراءات خبيثة. ويكمن الفرق الجوهري بين هذا الهجوم وحقن المطالبات التقليدي في أن هذا الاختراق يعطل عملية التخطيط متعددة الخطوات للوكيل، بدلاً من مجرد خداع النموذج لتقديم إجابة واحدة سيئة.

مثال: يقوم المهاجم بتضمين تعليمات مخفية داخل صفحة ويب، وبمجرد أن يقوم وكيل الذكاء الاصطناعي بمعالجتها وتحليلها، فإنها تُفعّل أمراً بتصدير سجل المتصفح الخاص بالمستخدم. وتم عرض ثغرة أمنية من هذا النوع بالذات في دراسة EchoLeak.

إساءة استخدام الأدوات واستغلالها (ASI02)

ينشأ هذا الخطر عندما يقوم الوكيل – مدفوعًا بأوامر غامضة أو بتأثير من جهات خبيثة – باستخدام الأدوات المشروعة المتاحة له بطرق غير آمنة أو غير مقصودة. وتشمل الأمثلة على ذلك الحذف الجماعي للبيانات، أو إرسال طلبات متكررة وفائضة لواجهات برمجة التطبيقات (API) المدفوعة. وغالبًا ما تُنفذ هذه الهجمات عبر سلاسل استدعاء معقدة، مما يتيح لها المرور دون أن ترصدها أنظمة مراقبة المضيف التقليدية.

مثال: يمكن التلاعب بروبوت دردشة لخدمة العملاء يمتلك صلاحية الوصول إلى واجهة برمجة تطبيقات مالية لمعالجة عمليات استرداد أموال غير مصرح بها، وذلك لعدم تقييد صلاحياته في وضع القراءة فقط. وهناك مثال آخر هو تسريب البيانات عبر استعلامات نظام أسماء النطاقات (DNS)، بشكل مشابه للهجوم الذي استهدف Amazon Q.

إساءة استخدام الهوية والامتيازات (ASI03)

تتعلق هذه الثغرة الأمنية بطريقة منح الأذونات وتوريثها ضمن تدفقات عمل الوكيل. ويستغل المهاجمون الأذونات الحالية أو بيانات الاعتماد المخزنة مؤقتًا لتصعيد الامتيازات أو تنفيذ إجراءات لم يكن المستخدم الأصلي مخولاً لتنفيذها. ويزداد هذا الخطر عندما يستخدم الوكلاء هويات مشتركة، أو يعيدون استخدام رموز المصادقة عبر سياقات أمنية مختلفة.

مثال: ينشئ موظف وكيل ذكاء اصطناعي يستخدم بيانات اعتماده الشخصية للوصول إلى الأنظمة الداخلية. وإذا تمت مشاركة هذا الوكيل لاحقًا مع زملاء آخرين في العمل، فإن أي طلبات يوجهونها للوكيل ستُنفذ أيضًا باستخدام الامتيازات المرتفعة لمنشئ الوكيل الأصلي.

الثغرات الأمنية في سلسلة توريد الوكلاء (ASI04)

تنشأ المخاطر عند استخدام نماذج أو أدوات أو شخصيات وكلاء جاهزة تابعة لأطراف خارجية، والتي قد تكون مخترقة أو خبيثة منذ البداية. وما يجعل الأمر أكثر تعقيدًا مقارنة بالبرامج التقليدية هو أن مكونات الوكلاء غالبًا ما يتم تحميلها ديناميكيًا، ولا تكون معروفة مسبقًا. ويرفع هذا مستوى الخطر بشكل كبير، خاصة إذا سُمح للوكيل بالبحث عن حزمة برمجية مناسبة بمفرده. ونشهد حاليًا طفرة في هجمات التحايل الإملائي، حيث تحاكي الأدوات الخبيثة في السجلات أسماء المكتبات الشهيرة، وكذلك هجمات التحايل العشوائي المرتبطة بها، حيث يحاول الوكيل استدعاء أدوات غير موجودة أصلاً.

مثال: يقوم وكيل مساعد برمجيًا بتثبيت حزمة مخترقة تحتوي على باب خلفي بشكل آلي، مما يسمح للمهاجم بسحب رموز التكامل والنشر المستمر ومفاتيح SSH مباشرة من بيئة عمل الوكيل. وقد رأينا بالفعل محاولات موثقة لهجمات تدميرية استهدفت وكلاء تطوير الذكاء الاصطناعي في الواقع.

تنفيذ الأوامر البرمجية غير المتوقع / تنفيذ الأوامر البرمجية عن بُعد (ASI05)

تقوم الأنظمة القائمة على الوكلاء بإنشاء وتنفيذ التعليمات البرمجية بشكل متكرر في الوقت الفعلي لإنجاز المهام، مما يفتح الباب أمام النصوص البرمجية أو الملفات الثنائية الخبيثة. ومن خلال حقن المطالبات وتقنيات أخرى، يمكن استدراج الوكيل لتشغيل أدواته المتاحة بمعايير خطيرة، أو تنفيذ تعليمات برمجىة مقدمة مباشرة من المهاجم. ويمكن أن يتصاعد هذا الأمر ليتحول إلى اختراق كامل للحاوية أو المضيف، أو الهروب من بيئة العزل – وعند هذه النقطة، يصبح الهجوم غير مرئي لأدوات مراقبة الذكاء الاصطناعي القياسية.

مثال: يرسل مهاجم مطالبة، يتخفى في هيئة اختبار للتعليمات البرمجية، ليخدع وكيل برمجة الإلهام لتنزيل أمر عبر أداة cURL وتوجيهه مباشرة إلى واجهة الأوامر.

تسميم الذاكرة والسياق (ASI06)

يقوم المهاجمون بتعديل المعلومات التي يعتمد عليها الوكيل لضمان استمرارية عمله، مثل سجل الحوار، أو قاعدة معرفة التوليد المسترد المعزز (RAG)، أو ملخصات مراحل المهام السابقة. ويؤدي هذا السياق المسموم إلى تشويه منطق الاستنتاج لدى الوكيل واختياره للأدوات في المستقبل. ونتيجة لذلك، قد تظهر أبواب خلفية مستمرة في منطقه البرمجي تظل باقية حتى بين الجلسات المختلفة. وخلافًا لعمليات الحقن التي تحدث لمرة واحدة، يتسبب هذا الخطر في تأثير طويل الأمد على معرفة النظام ومنطق سلوكه.

مثال: يزرع مهاجم بيانات كاذبة في ذاكرة الوكيل المساعد تتعلق بأسعار رحلات طيران مقدمة من أحد الموردين. ونتيجة لذلك، يوافق الوكيل على معاملات مستقبلية بأسعار احتيالية. وقد تم استعراض مثال على غرس الذكريات الزائفة في هجوم تجريبي استهدف Gemini.

الاتصالات غير الآمنة بين الوكلاء (ASI07)

في الأنظمة متعددة الوكلاء، يتم التنسيق عبر واجهات برمجة التطبيقات (APIs) أو نواقل الرسائل التي لا تزال تفتقر في كثير من الأحيان إلى التشفير الأساسي أو المصادقة أو فحوصات التحقق من السلامة. ويمكن للمهاجمين اعتراض هذه الرسائل أو تزويرها أو تعديلها في الوقت الفعلي، مما يتسبب في تعطل النظام الموزع بالكامل. وتفتح هذه الثغرة الباب أمام هجمات الوكيل الوسيط، بالإضافة إلى استغلال ثغرات الاتصال الكلاسيكية المعروفة في عالم أمن المعلومات التطبيقي، مثل: إعادة إرسال الرسائل، وتزوير هوية المرسل، وخفض إصدار البروتوكول قسريًا.

مثال: إجبار الوكلاء على الانتقال إلى بروتوكول غير مشفر لحقن أوامر مخفية، مما يؤدي فعليًا إلى اختطاف عملية صنع القرار الجماعي لمجموعة الوكلاء بالكامل.

الإخفاقات المتتالية (ASI08)

يصف هذا الخطر كيف يمكن لخطأ واحد، ناتج عن هلوسة، أو حقن مطالبات، أو أي خلل آخر، أن ينتشر ويتضخم عبر سلسلة من الوكلاء المستقلين. ولأن هؤلاء الوكلاء يتبادلون المهام فيما بينهم دون تدخل بشري، فإن الفشل في حلقة واحدة قد يؤدي إلى تأثير الدومينو الذي ينتهي بانهيار شامل للشبكة بأكملها. وتكمن المشكلة الأساسية هنا في السرعة الفائقة لانتشار الخطأ؛ فهو ينتشر بمعدل أسرع بكثير مما يمكن لأي مشغل بشري تتبعه أو إيقافه.

مثال: يصدر وكيل جدولة مخترَق سلسلة من الأوامر غير الآمنة التي تُنفذ تلقائيًا بواسطة الوكلاء التابعين له في مراحل العمل اللاحقة، مما يؤدي إلى حلقة مفرغة من الأفعال الخطيرة التي تتكرر عبر المؤسسة بأكملها.

استغلال الثقة بين البشر والوكلاء (ASI09)

يستغل المهاجمون الطبيعة الحوارية للوكلاء وما يبدو عليها من خبرة واسعة للتلاعب بالمستخدمين. ويؤدي تجسيد الصفات البشرية للذكاء الاصطناعي إلى وضع ثقة مفرطة في توصياته، والموافقة على إجراءات حرجة دون تفكير ثانٍ. وفي هذه الحالة، يعمل الوكيل كمستشار سيء، محوّلاً الإنسان إلى المنفذ النهائي للهجوم، مما يؤدي إلى تعقيد التحقيقات الجنائية الرقمية لاحقًا.

مثال: يشير وكيل دعم فني مخترق إلى أرقام تذاكر دعم حقيقية لبناء علاقة ثقة مع موظف جديد، ومن ثم يستدرجه تدريجيًا عبر أسلوب لبق لتسليم بيانات اعتماده الخاصة بالشركة.

الوكلاء المارقون (ASI10)

هؤلاء وكلاء خبيثون أو مخترقون أو واقعون في فخ الهلوسة، ينحرفون عن وظائفهم الموكلة إليهم، ويعملون في خفاء أو كطفيليات داخل النظام. وبمجرد فقدان السيطرة عليهم، قد يبدأ هذا النوع من الوكلاء في التكاثر الذاتي، أو السعي وراء أجندة خفية خاصة به، أو حتى التواطؤ مع وكلاء آخرين لتجاوز التدابير الأمنية. إن التهديد الأساسي الذي يصفه ASI10 هو التآكل طويل الأمد لسلامة سلوك النظام في أعقاب اختراق أولي أو حدوث خلل ما.

مثال: تتعلق الحالة الأكثر شهرة بوكيل تطوير مستقل تابع لشركة Replit خرج عن السيطرة، حيث حذف قاعدة بيانات العملاء الرئيسية للشركة، ثم قام بتزييف محتوياتها بالكامل ليبدو الأمر وكأن الخلل قد تم إصلاحه.

تخفيف حدة المخاطر في أنظمة الذكاء الاصطناعي القائمة على الوكلاء

بينما تجعل الطبيعة الاحتمالية لتوليد النماذج اللغوية الكبيرة، وغياب الفصل بين مسارات التعليمات وقنوات البيانات، من الوصول إلى أمانٍ مضاد للرصاص أمرًا مستحيلاً؛ فإن تبني مجموعة صارمة من الضوابط، التي تقترب من إستراتيجية انعدام الثقة، يمكن أن يحد بشكل كبير من الأضرار عندما تسوء الأمور. وفيما يلي التدابير الأكثر أهمية.

طبق مبدأي الحد الأدنى من الاستقلالية والحد الأدنى من الامتيازات. قيد استقلالية وكلاء الذكاء الاصطناعي عبر تكليفهم بمهام ذات ضوابط حماية محددة بدقة. وتأكد من منحهم حق الوصول فقط إلى الأدوات، وواجهات برمجة التطبيقات (APIs)، وبيانات الشركة الضرورية لإنجاز مهمتهم. ويجب خفض الأذونات إلى الحد الأدنى المطلق كلما كان ذلك متاحًا، على سبيل المثال، الاكتفاء بوضع القراءة فقط.

استخدم بيانات اعتماد قصيرة الأجل. وقم بإصدار رموز ومفاتيح واجهات برمجة تطبيقات مؤقتة ذات نطاق محدود لكل مهمة محددة. ويمنع هذا الإجراء المهاجم من إعادة استخدام بيانات الاعتماد في حال نجاحه في اختراق الوكيل.

إلزامية وجود الإنسان في حلقة القرار للعمليات الحرجة. يجب اشتراط طلب تأكيد بشري صريح لأي إجراءات غير قابلة للتراجع عنها أو عالية المخاطر، مثل منح الإذن للتحويلات المالية أو الحذف الجماعي للبيانات.

عزل التنفيذ والتحكم في حركة البيانات. قم بتشغيل التعليمات البرمجية والأدوات في بيئات معزولة (حاويات أو بيئات عزل) مع وضع قوائم سماح صارمة للأدوات واتصالات الشبكة؛ لمنع أي اتصالات خارجية غير مصرح بها.

فرض السياسة. انشر بوابات فحص النوايا لمراجعة خطط الوكيل ومعاييره والتحقق من مطابقتها لقواعد أمنية صارمة قبل دخولها حيز التنفيذ.

التحقق من المدخلات والمخرجات وتنقيتها. استخدم عوامل التصفية متخصصة وأنظمة تحقق لفحص جميع المطالبات واستجابات النماذج للبحث عن عمليات حقن أو محتوى خبيث. ويجب أن يحدث هذا في كل مرحلة من مراحل معالجة البيانات وكلما تم تمرير البيانات بين الوكلاء.

التسجيل الآمن المستمر. سجل كل إجراء يتخذه الوكيل وكل رسالة متبادلة بين الوكلاء في سجلات غير قابلة للتعديل. وستكون هذه السجلات ضرورية لأي عمليات تدقيق أو تحقيقات جنائية رقمية في المستقبل.

المراقبة السلوكية ووكلاء الحماية. انشر أنظمة آلية لرصد السلوكيات المريبة، مثل الارتفاع المفاجئ في استدعاءات واجهات برمجة التطبيقات، أو محاولات التكاثر الذاتي، أو انحراف الوكيل المفاجئ عن أهدافه الأساسية. ويتقاطع هذا النهج بشكل كبير مع المراقبة المطلوبة لضبط هجمات الشبكة المتطورة من نوع العيش على موارد النظام. وبناءً عليه، فإن المؤسسات التي تبنت أنظمة XDR وتقوم بتحليل البيانات التشغيلية عن بُعد في نظام SIEM ستمتلك أسبقية هنا؛ حيث سيكون من الأسهل عليها إبقاء وكلاء الذكاء الاصطناعي تحت سيطرة محكمة.

التحكم في سلاسل التوريد وقوائم مكونات البرامج (SBOMs). استخدم الأدوات والنماذج المعتمدة من سجلات موثوقة فقط. وعند تطوير البرامج، قم بتوقيع كل مكون، وتثبيت إصدارات التبعيات، وفحص كل تحديث بدقة.

التحليل الساكن والديناميكي للتعليمات البرمجية التي تم توليدها. افحص كل سطر من التعليمات البرمجية التي يكتبها الوكيل بحثًا عن الثغرات الأمنية قبل التشغيل. وحظر استخدام الوظائف الخطرة مثل eval() تمامًا. ويجب أن تكون هاتان النصيحتان الأخيرتان جزءًا أصيلاً من سير عمل التطوير والأمان والعمليات (DevSecOps) القياسي ، ويجب تعميمهما لتشملا كل التعليمات البرمجية التي يكتبها وكلاء الذكاء الاصطناعي. ونظرًا لأن فعل ذلك يدويًا أمر شبه مستحيل، فمن المستحسن استخدام أدوات الأتمتة، مثل تلك المتوفرة في Kaspersky Cloud Workload Security.

تأمين الاتصالات بين الوكلاء. احرص على تفعيل المصادقة المتبادلة والتشفير في جميع قنوات الاتصال بين الوكلاء. واستخدم التوقيعات الرقمية للتحقق من سلامة الرسائل.

مفاتيح الإيقاف الفوري للاتصالات. ابتكر طرقًا لإغلاق الوكلاء أو أدوات محددة فورًا في اللحظة التي يتم فيها رصد سلوك غير طبيعي.

استخدام واجهة المستخدم لضبط مستويات الثقة. استخدم مؤشرات بصرية للمخاطر وتنبيهات لمستويات الثقة لتقليل احتمالية ثقة البشر العمياء بالذكاء الاصطناعي.

تدريب المستخدمين. ينبغي تدريب الموظفين بشكل منهجي على الواقع التشغيلي للأنظمة المدعومة بالذكاء الاصطناعي. واستخدم أمثلة مصممة خصيصًا لتناسب أدوارهم الوظيفية الفعلية لتفكيك المخاطر المتعلقة بالذكاء الاصطناعي. ونظرًا للسرعة الفائقة التي يتحرك بها هذا المجال، فإن فيديو الامتثال السنوي لن يفي بالغرض؛ بل يجب تحديث هذا التدريب عدة مرات في السنة.

بالنسبة لمحللي مراكز العمليات الأمنية، نوصي أيضًا بدورة تدريب خبراء Kaspersky: أمان نماذج اللغات الكبيرة، التي تغطي التهديدات الرئيسية التي تواجه النماذج اللغوية الكبيرة، والإستراتيجيات الدفاعية للتصدي لها. وستكون الدورة مفيدة أيضًا للمطورين ومهندسي الذكاء الاصطناعي الذين يعملون على تنفيذ مشاريع النماذج اللغوية الكبيرة.

الذكاء الاصطناعي

الذكاء الاصطناعي

النصائح

النصائح