تنتقل الوكلاء الذكية بسرعة من عروض توضيحية مبهرة إلى أدوات فعلية قادرة على التصرف نيابةً عنك، ويعد OpenClaw اسمًا بارزًا في موجة الاهتمام الأخيرة. ربما سمعت البرنامج نفسه يُشار إليه أحيانًا باسم Clawdbot أو Moltbot، أسماء استخدمها مبتكره، المطوّر النمساوي Peter Steinberger، في مراحل تطوير مختلفة.

يُروَّج له كمساعد شخصي يعمل دون إشراف مباشر ويمكنه تشغيل برامج نيابةً عنك، لكنه يثير أيضًا أسئلة مهمة حول الوصول والأمن.

- الوكيل الذكي عبارة عن نظام ذكاء اصطناعي قادر على التنفيذ، وليس مجرد أداة محادثة.

- أدوات مثل OpenClaw تبرز مدى قوة الوكلاء المستضافة محليًا.

- تُدخل هذه القوة مخاطر أمنية جديدة عندما يعالج الوكيل مدخلات غير موثوقة.

- هجمات حقن المطالبات تشكّل تهديدًا رئيسيًا للوكلاء، وأكثر خطورة مما هي عليه في الدردشة الآلية.

- يمكن أن تضخّم الذاكرة المستمرة الأخطاء وتطيل مدة الهجمات.

- هذه الوكلاء قوية، لكنها ليست خيارًا آمنًا افتراضيًا لمعظم المستهلكين.

ما هو الضجيج حول OpenClaw؟

يحظى OpenClaw بالاهتمام لأنه يمثل تحوّلًا من أنظمة ذكاء اصطناعي تجيب عن الأسئلة إلى أنظمة قادرة على تنفيذ مهام فعلية على نظام حقيقي وحتى استخدام برامج. قضايا الأمان المحتملة دفعت العديد من المختصين في الأمن للتحدث عنه. فما الذي يجعل OpenClaw جذابًا للمطورين ومستخدمي الخبرة؟

يتميّز OpenClaw بقدرته على اتخاذ إجراءات حقيقية، وليس مجرد توليد نص أو اقتراحات. بدلًا من أن يخبرك بما يجب فعله، يمكنه القيام بالأفعال بنفسه. تتيح التقنية فتح التطبيقات، إرسال الرسائل، نقل الملفات، تنفيذ الأوامر، والتفاعل مع الأنظمة مباشرةً نيابةً عن المستخدم.

هذا المستوى من الأتمتة هو ما يجذب الاهتمام. يرى المطوّرون ومستخدمو الخبرة أن التحكم على مستوى النظام وسيلة لتقليل الأعمال المتكررة أو لأتمتة سير العمل. فكرة وكيل ذكاء اصطناعي «يقوم بالمهمة» بدلاً من المساعدة من على الهامش فكرة قوية.

هذا الوعد بالقدرة العملية هو السبب في انتقال OpenClaw سريعًا من مشروع متخصص إلى موضوع نقاش أوسع.

لماذا هذا مهم أبعد من OpenClaw

يقدّم OpenClaw مثالًا واضحًا على التحوّل الأوسع نحو الوكلاء الذين يتصرفون فعليًا، لا يكتفون بالردّ أو تقديم النصائح.

تصبح أسئلة سوء الاستخدام المحتمل لا مفرّ منها مع نمو هذه التقنية. ما يظهره OpenClaw هو الوجهة التي يتجه إليها مجال الذكاء الاصطناعي، ما يجعل المسألة ذات صلة تتجاوز مشروعًا واحدًا ويضع الأساس لنقاشات مستمرة حول كيفية التحكم في هؤلاء الوكلاء. هل يمكن الوثوق بهم؟

ما هم وكلاء الذكاء الاصطناعي، وما الذي يميزهم عن أدوات الذكاء الاصطناعي الأخرى؟

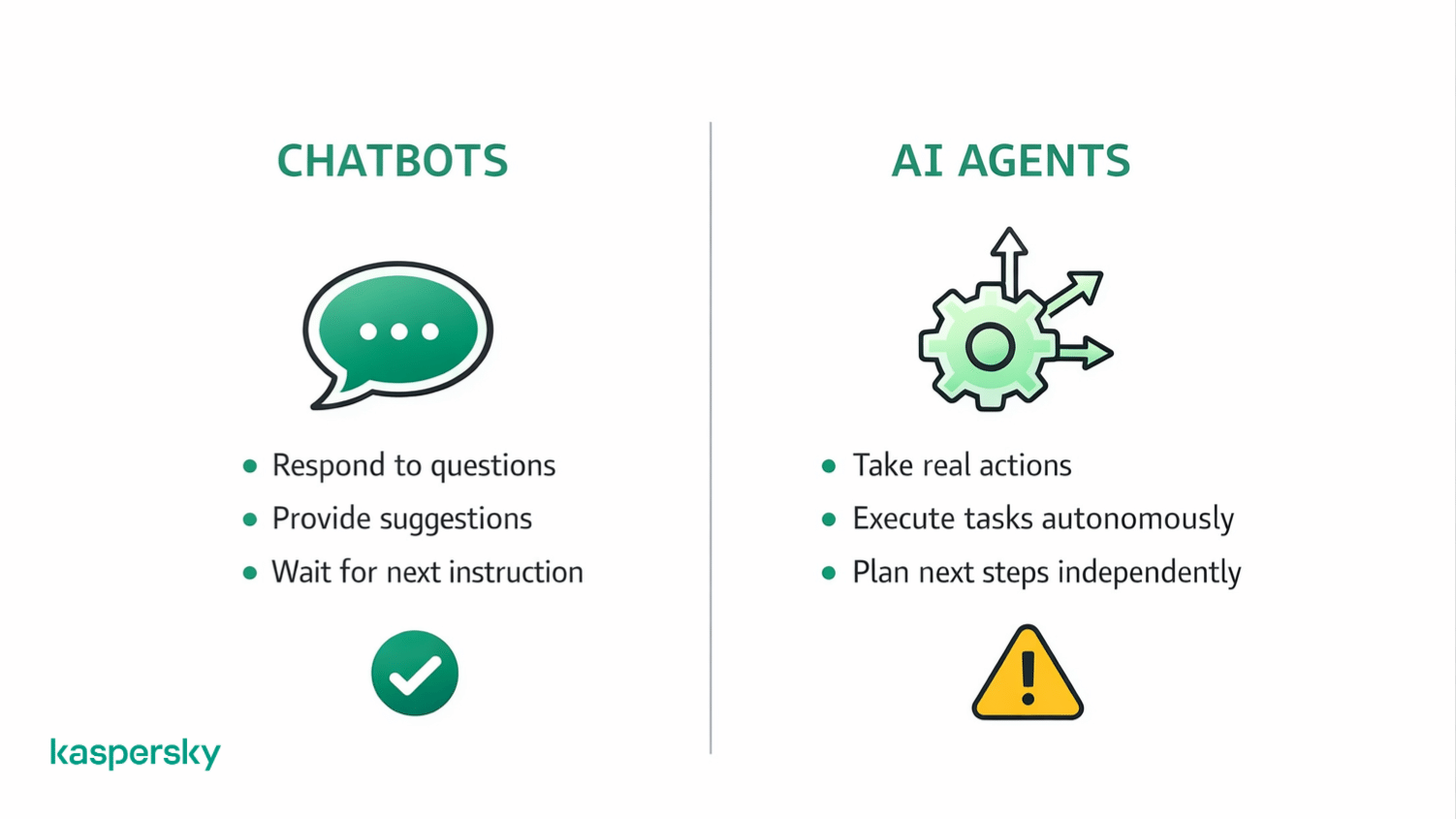

الوكلاء ليست أنظمة تكتفي بتقديم إجابات نصية أو صوتية على أسئلتك. بل يمكنها التخطيط لخطوات وتنفيذ إجراءات لتحقيق هدف محدد. بدلاً من التوقّف عند تقديم نصيحة، تقرر ما الذي يجب فعله تاليًا وتقوم بتنفيذه.

يمكن لوكيل ذكاء اصطناعي ملاحظة موقف ما واتخاذ إجراء. هذا يختلف عن معظم أدوات الذكاء الاصطناعي التي تستجيب للمطالبات لكنها تنتظر التعليمات التالية. من الأمثلة المبكرة وكلاء تنفيذ المهام مثل Manus (المملوكة الآن لشركة Meta). يوضّح Manus كيف يمكن للوكلاء أن يتجاوزوا حدود الدردشة إلى التنفيذ. يمكنه إجراء تحليل بيانات أو حتى كتابة كود لحل مشكلات دون الحاجة إلى توجيه تفصيلي—وبمشاركة بشرية أقل.

يبني OpenClaw على نفس فكرة الوكلاء القادرين على التنفيذ، لكنه يطبّقها بطريقة أكثر مباشرة وقوة.

هل OpenClaw وكيل ذكاء اصطناعي نموذجي أم أكثر تقدّمًا؟

يصنف OpenClaw ضمن فئة الوكلاء القادرين على التنفيذ. وهو يقدم تنفيذًا أقوى من العديد من الأدوات التي يعرفها معظم الناس حاليًا.

تستطيع هذه الأداة التخطيط للمهام والتصرف دون مدخلات مستمرة. يمكن لـ OpenClaw التفاعل مباشرة مع البرامج ونظام التشغيل، وليس فقط مع APIs أو أدوات محدودة. هذا الوصول الأوسع يزيد من الفائدة ويجعله مختلفًا. لكنه أيضًا يرفع مستوى المخاطر وأهمية جوانب الأمان.

لماذا الوكلاء المستضافة محليًا مختلفة

تعمل الوكلاء المستضافة محليًا على نظامك الخاص بدلاً من خدمة بعيدة. هذا يمنح المستخدمين مزيدًا من السيطرة على التهيئة والسلوك. لكنه يغيّر أيضًا من مسؤولية الأمان.

عندما يحصل الوكيل على وصول محلي، يعتمد الأمان على كيفية إعداده، وما الأذونات الممنوحة له، وكيفية مراقبته. مزيد من السيطرة يعني مزيدًا من المخاطر.

تُظهر مشاريع حديثة كيف بدأ مفهوم "المستضاف محليًا" يتغير. على سبيل المثال، يمكن الآن تشغيل Moltbot (سابقًا Clawdbot) باستخدام Moltworker مفتوح المصدر من Cloudflare. هذا يلغي الحاجة إلى جهاز محلي مخصّص عن طريق تشغيل الوكيل على منصة مُدارة بدلاً من ذلك.

يخفض هذا الحاجز أمام الاستخدام ويبسط الإعداد، لكنه يحوّل أيضًا موقع السيطرة. عندما يعمل الوكيل على بنية سحابية، لا يعتمد الأمان على الوكيل نفسه فحسب، بل أيضًا على ضوابط الوصول وكيفية التعامل مع البيانات والأذونات عبر المنصة.

على سبيل المثال، قد يربط المستخدم وكيل ذكاء اصطناعي ببريده الإلكتروني على أمل أن يقرأ الرسائل فقط، بينما تسمح إعدادات السحابة أيضًا بإرسال رسائل ما لم تُلغَ هذه الصلاحية صراحة.

كيف تختلف الوكلاء عن روبوتات الدردشة مثل ChatGPT؟

روبوتات الدردشة مثل ChatGPT تقدّم اقتراحات أو تفسيرات. أما الوكلاء فيمكنهم فتح برامج أو اتباع سير عمل فعليًا.

كمثال، استخدم بعض الأشخاص OpenClaw لأتمتة التداول. وضعوا قواعد وطلبوا من النظام ألا يكتفي بالنصيحة (وهو ما قد يوفره ChatGPT) بل تنفيذ صفقات فعلية.

لماذا تقدّم الوكلاء مخاطر أمنيّة جديدة؟

كما ذُكِر سابقًا، تتخذ الوكلاء إجراءات بدلًا من الاكتفاء بالنصيحة. وغالبًا ما يرافق ذلك حصولها على وصول إلى ملفات أو تطبيقات أو وظائف النظام.

الوصول والاستقلالية التي يمنحها OpenClaw يغيران من مدى التأثير والمخاطر. سيطلب OpenClaw إذنًا للتفاعل مع برامج أو لاتخاذ إجراءات مثل إرسال بريد إلكتروني أو ملء نماذج دون إشرافك المباشر. هذا يجعله عنصرًا غير متوقع النتائج.

الأخطاء أو التلاعب يمكن أن تكون لها عواقب حقيقية. الخطر ليس فقط في ما يُطلب من الوكيل فعله، بل في ما يفسّره الوكيل على أنه تعليمات أثناء تنفيذ مهمة.

لماذا تعتبر المدخلات غير الموثوقة مشكلة جوهرية

تستهلك الوكلاء كميات كبيرة من المحتوى الخارجي (مثل صفحات الويب والمستندات) لتقرر ما الذي ستفعله بعد ذلك. هذا المحتوى ليس دائمًا موثوقًا.

لا يجب أن تكون التعليمات مباشرة. يمكن أن تُخبأ داخل نص أو بيانات يقرأها الوكيل أثناء أداء مهمة. هذا يجعل من الممكن للمهاجمين التأثير على سلوك الوكيل دون التفاعل معه مباشرةً.

تخلق هذه المسألة طريقًا واضحًا لحقن المطالبات. هنا تُستغل المدخلات غير الموثوقة لتوجيه الوكيل إلى تنفيذ إجراءات لم يُقصَد بها.

تتطلّب أدوات الذكاء الاصطناعي القوية حماية أقوى

يمكن للوكلاء الوصول إلى الملفات والبريد الإلكتروني ووظائف النظام. يساعد Kaspersky Premium في اكتشاف السلوك المشبوه، حظر السكربتات الخبيثة، وحماية أجهزتك من التهديدات السيبرانية الواقعية.

جرّب Kaspersky Premium مجانًاما هو حقن المطالبات في الوكلاء؟

حقن المطالبات هو أسلوب للتلاعب بوكيل الذكاء الاصطناعي عن طريق تغذيته بمحتوى غير موثوق يغيّر من سلوكه.

الخطر هنا ليس خطأ برمجيًا تقنيًا بالضرورة، بل أن الوكيل قد يفسّر المدخلات الخارجية مثل الرسائل الفورية أو التعليقات على أنها تعليمات. وعند حدوث ذلك، قد يُوجَّه الوكيل لتنفيذ إجراءات لم تُقصَد به.

كيف يعمل حقن المطالبات في سيناريوهات العالم الحقيقي

يمكن أن يكون حقن المطالبات مباشرًا أو غير مباشر.

- مباشر — يدرج المهاجم تعليمات صريحة في المحتوى الذي يقرأه الوكيل.

- غير مباشر — يلتقط الوكيل تعليمات مخفية أو غير متوقعة من موقع ويب أو رسالة يعالجها أثناء مهمة عادية.

المسألة الأساسية هي السلوك. قد يتبع الوكيل ما يفسّره على أنه إرشاد، حتى لو جاء هذا الإرشاد من مصادر غير موثوقة. لا يلزم وجود خطأ برمجي كلاسيكي ليحدث ذلك.

لماذا حقن المطالبات أخطر لدى الوكلاء منه لدى روبوتات الدردشة

عادةً ما تؤثر التعليمات المحقونة على الردود والنصائح التي تقدمها روبوتات الدردشة. مع الوكلاء، يمكن أن تؤثر على الأفعال نفسها.

إذا كان لدى الوكيل وصول إلى الملفات أو عناصر تحكم النظام، يمكن أن تؤدي التعليمات المُعدَّلة إلى تغييرات حقيقية في العالم الفعلي. لهذا السبب يشكل حقن المطالبات خطرًا أكبر بالنسبة للوكلاء؛ نفس التقنية التي تغيّر مخرجات نصية في روبوت دردشة قد تُشغّل إجراءات غير مقصودة عند وجود وكيل قادر على التنفيذ.

ما هي الذاكرة المستمرة في الوكلاء؟

الذاكرة المستمرة تتيح للوكيل الاحتفاظ بمعلومات مع مرور الوقت. هذا يعني أنه يمكنه استخدام مدخلات سابقة لتوجيه قرارات مستقبلية بدلًا من البدء من جديد مع كل مهمة.

ماذا تعني الذاكرة المستمرة للوكيل

يمكن للوكيل تخزين سياق وتعليمات عبر جلسات متعدّدة وتطوير "سلوكيات" مفضلة. يساعد ذلك الوكيل على العمل بكفاءة أكبر عن طريق تذكّر ما تعلّمه أو فعله سابقًا.

كما يعني ذلك أن المدخلات السابقة يمكن أن تؤثر على السلوك اللاحق. فالتعليمات أو الافتراضات التي التُقطت في مهمة سابقة قد لا تزال تشكّل طريقة عمل الوكيل في موقف مختلف، حتى لو لم يعد المستخدم على دراية بها.

لماذا تزيد الذاكرة المستمرة من مخاطر الأمان

يمكن أن تُدخل الذاكرة المستمرة تأثيرات متأخرة. قد لا تسبب تعليمات ضارة مشكلات فورية، لكنها قد تعاود الظهور لاحقًا عند توافر شروط مناسبة.

هذا يجعل عملية التنظيف أصعب. قد يتكرر السلوك المخزّن عبر مهام متعددة. غالبًا ما يتطلب استعادة الوكيل بالكامل مسح الذاكرة أو إعادة بناء التهيئات لضمان إزالة التأثيرات غير المرغوبة.

ماذا يحدث عندما يُسيء تكوين وكيل ذكاء اصطناعي أو يتعرّض؟

يمكن الوصول إلى وكيل ذكاء اصطناعي أو التأثير عليه بطرق لم يقصدها المالك، فيتحول من أداة مساعدة إلى خطر أمني محتمل.

يمكن أن يحدث ذلك عن طريق خطأ أو سوء فهم. ويمكن أن يحدث أيضًا إذا حاول طرف ثالث التلاعب بالوكيل.

كيف يمكن أن يتعرّض وكيل دون قصد

غالبًا ما يحدث التعرض بسبب أخطاء بسيطة. أمر بسيط مثل مصادقة ضعيفة أو أذونات واسعة جدًا قد يجعل الوكيل قابلاً للوصول من خارج بيئته المقصودة.

تشغيل وكيل محليًا لا يجعله آمنًا بالضرورة. إذا اتصل بالإنترنت أو تفاعل مع أنظمة أخرى فقد يتعرّض للتأثير. تقلّل السيطرة المحلية من بعض المخاطر لكنها لا تلغيها.

لماذا تصبح الوكلاء المعرضة أسطح هجوم

بمجرد تعرضها، تتحول الوكلاء إلى أهداف يمكن للمهاجمين فحصها، اختبارها، والتأثير عليها. قد يحاولون تغذيتها بمدخلات مُصمَّمة، تحفيز إجراءات، أو تعلّم كيف تتصرّف على المدى الطويل.

وبما أن الوكلاء يمكنهم اتخاذ إجراءات حقيقية، فلا يجب أن يبدو سوء الاستخدام كاختراق تقليدي. قد يشمل الاستغلال توجيه السلوك، استخراج البيانات، أو التسبب في تغييرات نظامية غير مقصودة، وكل ذلك دون استغلال عيب برمجي كلاسيكي.

ما هي "الثالوث القاتل" في أمن الوكلاء؟

يصف مصطلح "الثالوث القاتل" ثلاثة شروط تشكّل معًا خطرًا أمنيًا جسيمًا للوكلاء.

الشروط الثلاثة التي تمكّن هجمات خطيرة

- الشرط الأول هو الوصول إلى بيانات حساسة، مثل ملفات أو بيانات اعتماد أو معلومات داخلية.

- الثاني هو المدخلات غير الموثوقة، أي أن الوكيل يستهلك محتوى لا يمكنه التحقق منه تمامًا.

- الثالث هو القدرة على اتخاذ إجراءات خارجية، مثل إرسال طلبات، تعديل الأنظمة، أو تنفيذ أوامر.

كل عامل بمفرده قد يكون قابلًا للإدارة. لكن الخطر يتصاعد عندما تتجمّع هذه العوامل في هذا الثالوث. الوكيل الذي يقرأ مدخلات غير موثوقة وقادر على التصرف بشأنها يخلق طريقًا واضحًا للاستغلال. التحكم في الأذونات الممنوحة للوكيل أمر حيوي.

هل يجب على المستخدمين العاديين تشغيل الوكلاء اليوم؟

بالنسبة لمعظم الناس، لا تزال الوكلاء أدوات تجريبية. يمكن أن تكون مفيدة في بيئة مضبوطة. لكن العيب أنها أيضًا قد تُدخل مخاطر جديدة ليست واضحة دائمًا.

متى يمكن أن يكون استخدام وكيل منطقيًا

قد يكون تشغيل وكيل منطقيًا في سيناريوهات منخفضة المخاطر وتحت تحكم شديد. يشمل ذلك التجربة على جهاز منفصل. يحاول بعض المستخدمين تشغيل وكلاء يتعاملون فقط مع مهام غير حسّاسة مثل تنظيم الملفات أو اختبار سير العمل.

على سبيل المثال، إذا أردت أن يساعدك الوكيل في إعداد جدول رحلة قادمة، فيمكن منحه الوصول إلى المعلومات اللازمة لذلك ومنعه من التواصل المباشر مع أشخاص أو القيام بأي إجراءات قد تُسبب ضررًا.

إذا كنت مرتاحًا لإدارة الإعدادات والأخطاء المحتملة وليست "عالية المخاطر"، يمكن أن يكون الوكيل أداة تعليمية. المفتاح هو تقليص النطاق وتحديد الوصول بدقّة.

متى تكون الوكلاء فكرة سيئة

تعد الوكلاء خيارًا سيئًا عندما يكون لديها الوصول إلى بيانات حساسة أو حسابات مهمة. تشغيل وكلاء دون فهم الأذونات أو مخاطر المدخلات الخارجية يزيد الخطر بسرعة.

ومن المقبول أيضًا الامتناع عن استخدامها. قرار عدم تشغيل وكيل اليوم خيار معقول إذا كانت الراحة تأتي على حساب الأمان أو راحة البال.

ما هي الاحتياطات الأساسية الضرورية عند استخدام الوكلاء؟

تساعد الاحتياطات الأساسية في تقليل المخاطر ومنع الأخطاء من التحوّل إلى مشاكل خطيرة.

يمكن لبرامج Kaspersky أن تضيف طبقة حماية إضافية عن طريق الإشارة إلى السلوك المشبوه والمساعدة في حماية الحسابات من الاختراقات. خططنا تحمي من كل شيء بدءًا من البرامج الضارة والفيروسات إلى برامج الفدية وتطبيقات التجسس.

ما هي إجراءات الأمان الأكثر أهمية

العزل هو الأساس. شغّل الوكلاء على أجهزة وحسابات منفصلة كلما أمكن حتى لا تؤثر على بيانات أو أنظمة مهمة. حدّ الأذونات إلى ما يحتاجه الوكيل فعلًا فقط. نوصي بتجنّب منح الوصول الكامل للنظام أو للحسابات افتراضيًا.

خطوات الموافقة مهمة أيضًا. طلب التأكيد قبل الإجراءات الحساسة يضيف فاصلًا يمكنه منع سلوك غير مقصود، مثل الموافقة على إنفاق أموال نيابة عنك. هذه الضوابط البسيطة ذات تأثير كبير دون إضافة تعقيدات كبيرة.

ماذا تعني الوكلاء لمستقبل الذكاء الاصطناعي الاستهلاكي؟

تشير الوكلاء إلى مستقبل قد تقوم فيه أدوات الذكاء الاصطناعي بأكثر من مجرد المساعدة؛ ستتخذ إجراءات. لكن هذا التحوّل يأتي بتوازنات يجب أن يبدأ المستهلكون بالتعامل معها الآن.

ما الذي يخبرنا به هذا التطور عن نضج الوكلاء

الوكيل قوي لكنه غير ناضج بالكامل. يمكنه أتمتة مهام، لكنه لا يزال يعاني من بعض عناصر الحكم والأمان. هذا لا يعني أنه لن يصبح أكثر أمانًا أو موثوقية؛ يعني فقط أن التوقّعات يجب أن تظل واقعية.

تُظهر الوكلاء إلى أين تتجه الأمور، لكن الاستخدام الواسع واليومي سيتطلّب ضوابط أفضل وأدوات مصممة مع مراعاة الأمان منذ البداية.

مقالات ذات صلة:

- كيف يتعامل ChatGPT مع مخاوف الأمن السيبراني والمخاطر المحتملة؟

- ما هي مخاطر الجريمة السيبرانية المعتمدة على الذكاء الاصطناعي في المشهد الرقمي اليوم؟

- كيف يعزّز الذكاء الاصطناعي والتعلّم الآلي إجراءات الأمن السيبراني؟

- ما هي مخاطر تكنولوجيا Deepfake اليوم؟

منتجات موصى بها:

FAQs

هل يمكن تنزيل OpenClaw مجانًا؟

يمكن تنزيل OpenClaw مجانًا من Github. هو برنامج مفتوح المصدر، ما يمنح المطوّعين مساحة أكبر لتعديل وإعادة توزيع البرنامج.

هل من السهل إعداد OpenClaw؟

توجد دروس تعليمية يمكنها تشغيل البوتات بسرعة، لكن الإعداد المتقدّم يتطلّب وقتًا ومعرفة متخصّصة. هذا سبب إضافي يجعل تشغيل برنامج قد لا يكون مُعدًا بشكل صحيح أمرًا محفوفًا بالمخاطر.